Einleitung

Wenn du 2026 eine Image to Video API auswählst, reicht reine Qualität nicht mehr aus. Die besten Modelle konkurrieren heute bei Bewegungsrealismus, Konsistenz, Kamerasteuerung, Audio-Unterstützung, Generierungsgeschwindigkeit und der Frage, wie leicht sie sich in ein Produkt integrieren lassen. Genau deshalb ist diese Kategorie für Entwickler, Startups, Kreativteams und KI-Plattformen so wichtig: Das richtige Modell verändert sowohl die Ausgabequalität als auch die Kostenstruktur.

ModelHunter ist eine einheitliche API-Schicht für Video-, Bild- und Audiomodelle. Der Live-Modellmarkt hebt bereits Marken wie Vidu, Seedance, Kling, Seedream, Gemini und Wan hervor und behandelt image-to-video als eigenständige API-Kategorie.

Statt Modelle nur nach spektakulären Demos zu bewerten, konzentriert sich dieser Guide auf das, was in der Praxis zählt: Funktionen, Vor- und Nachteile, passende Workflows, Preistransparenz und aktuelle Verfügbarkeit. Für Teams, die entscheiden müssen, welches Modell sie in ihr Produkt oder ihren Workflow integrieren, sind dies die 10 Image-to-Video-Modelle, die man 2026 im Blick behalten sollte.

Schneller Vergleich und Zusammenfassung

Auf hoher Ebene teilt sich der Markt in einige klare Gruppen. Seedance 2.0, Runway Gen-4 und Gen-4.5, Google Veo 3.1 und OpenAI Sora 2 sind die stärksten Kandidaten für Premium-Qualität und fortgeschrittene Kontrolle. Kling 3.0 und Luma Ray 3.14 stechen bei cineastischer Bewegung und visueller Qualität hervor. Vidu Q3, Pika 2.5 und Wan 2.6 sind besonders attraktiv, wenn Geschwindigkeit, Preis oder Produktflexibilität wichtiger sind. Adobe Firefly bleibt die sicherste Option für markensensible Business-Teams, weil Adobe Firefly weiterhin stark auf kommerziell sichere Generierung und Creative-Cloud-Integration positioniert.

| Model | Am besten geeignet für | Größte Stärke | Wichtigster Trade-off |

|---|---|---|---|

| Seedance 2.0 | Cineastische Kontrolle | Multimodale Referenzen und Regie-artige Shot-Kontrolle | Konsistenz in komplexen Szenen bleibt schwierig |

| Runway Gen-4 / Gen-4.5 | Verlässliche Produktions-Workflows | Starke Kontinuität aus einem einzigen Bild und ausgereifte Produkt-UX | Bewegung wirkt mitunter sicherer und zurückhaltender |

| Google Veo 3.1 | Enterprise-API-Einsatz | Premium-Modellqualität plus Google-Ökosystem | Längere oder dichtere Sequenzen driften weiter |

| OpenAI Sora 2 | Breiter Einsatz für Creator und Developer | Deckt Consumer- und API-Workflows zugleich ab | Zeitliche Konsistenz ist in dichten Szenen weiter unvollkommen |

| Kling 3.0 | Dramatische cineastische Bewegung | Realismus, Energie und starke Kurzvideo-Dynamik | Weniger präzise Feinsteuerung |

| Luma Ray 3.14 | Ästhetisches Storytelling | Bewegung wirkt gestaltet statt nur animiert | Weniger geeignet für dichte, streng kontrollierte Action |

| Vidu Q3 | Preisbewusstes Storytelling | Lange Clips, natives Audio und praktischer Nutzen | Niedrigere Qualitätsobergrenze als im Premium-Segment |

| Pika 2.5 | Schnelle Creator-Iteration | Geschwindigkeit, Zugänglichkeit und expressive Effekte | Geringere Obergrenze bei Realismus und Kontrolle |

| Wan 2.6 | Multi-Mode-Video-Produkte | Einheitliche Familie über T2V, I2V und V2V | Breite schlägt nicht immer den besten Spezialisten |

| Adobe Firefly Video | Kommerzielle Workflows | Starke Ökosystem-Passung und markensichere Positionierung | Konservativere Bewegungsambition |

Detaillierte Bewertung jedes Modells

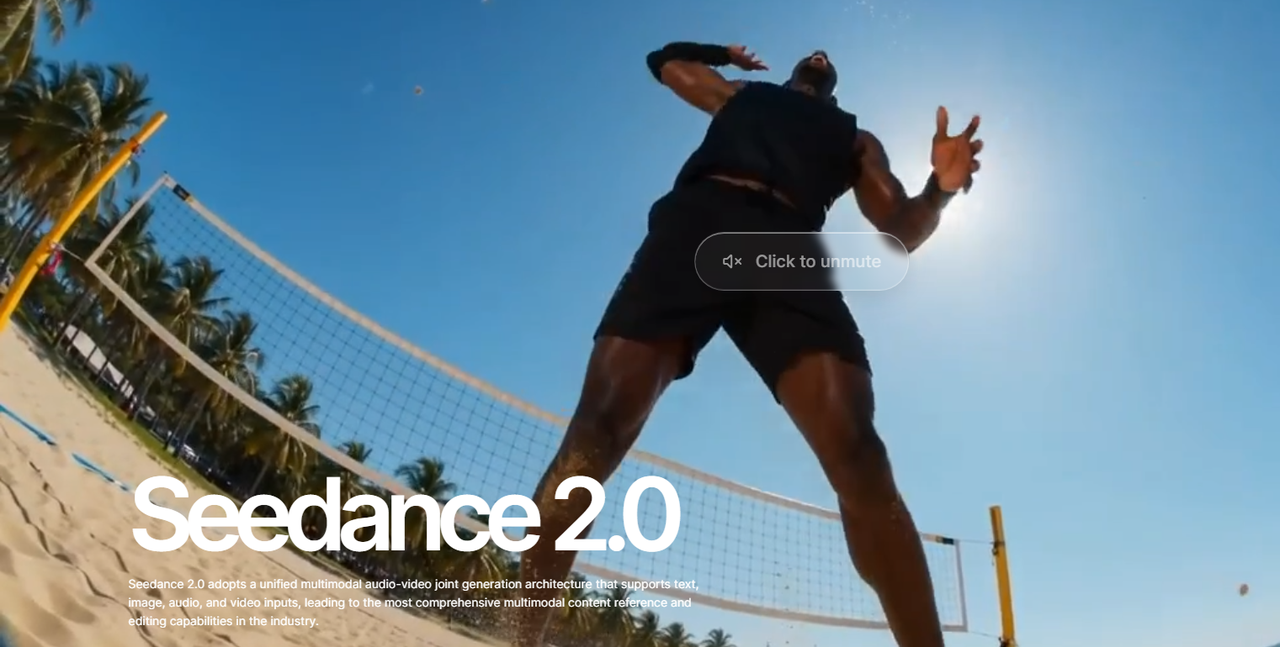

1. Seedance 2.0

Seedance 2.0 wirkt wie das kontrollorientierteste Modell in diesem Feld. ByteDance positioniert es rund um multimodale Referenzeingaben, darunter Bilder, Audio und Video, mit Regie-artiger Kontrolle über Performance, Licht, Schatten und Kamerabewegung. Das ist wichtig, weil viele Image-to-Video-Tools noch immer eher wie glorifizierte Animationsmaschinen wirken, während Seedance klar auf Shot-Design und geführte cineastische Generierung abzielt.

Die größte Stärke ist, wie ernst das Modell Referenzen nimmt. Wenn dein Workflow mit einem Standbild beginnt, du aber auch Stimmung, Bewegungssprache, Sound und Bildkomposition berücksichtigen willst, gehört Seedance zu den wenigen Modellen, die das als zusammenhängende kreative Aufgabe behandeln und nicht als Ein-Klick-Konvertierung. Dadurch ist es besonders interessant für Werbekreative, Brand Storytelling und hochwertigere Kurzvideo-Produktion.

Die größte Schwäche liegt nicht in der Idee, sondern in der Ausführung unter Druck. Fortgeschrittene Videoprobleme bleiben bestehen: Detailstabilität, Konsistenz über mehrere Personen hinweg und präzises Lip-Syncing in komplexen Szenen sind nach wie vor schwierig. Praktisch bedeutet das: Seedance ist besonders stark, wenn du cineastische Regie und strukturierte Bewegung willst, garantiert aber noch keine perfekten langen oder überfüllten Sequenzen.

Für API-Käufer ist Seedance 2.0 am besten als Premium-Kreativmotor zu verstehen und nicht als reibungsloses Commodity-Modell. Man nutzt es, wenn Kontrollqualität wichtiger ist als maximale Kostenvorhersagbarkeit.

Seedance 2.0 API jetzt ausprobieren

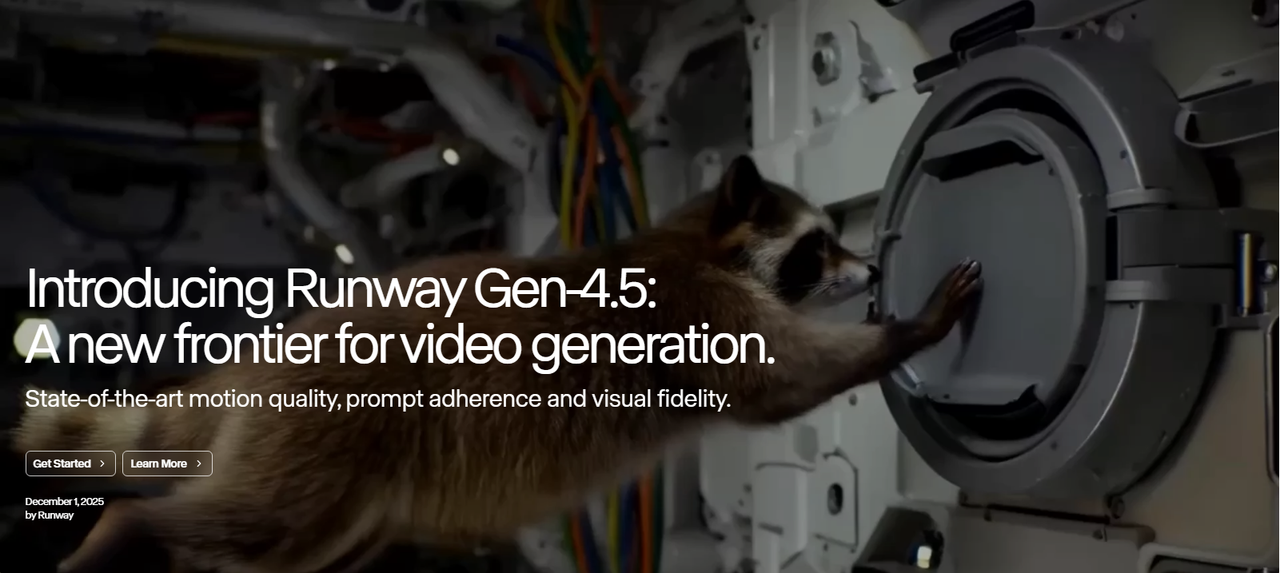

2. Runway Gen-4 / Gen-4.5

Runway bleibt eine der sichersten Empfehlungen, weil es nicht nur eine starke Modellfamilie ist, sondern auch ein reifes Produktumfeld. Die Positionierung von Gen-4 betont konsistente Charaktere, Objekte und Umgebungen aus einem einzigen Referenzbild heraus. Das ist ein echter Vorteil für Image-to-Video-Nutzer, die Kontinuität statt einzelner Glückstreffer brauchen.

In der Praxis ist der größte Vorteil von Runway seine Balance. Es versucht nicht immer, das experimentellste oder cineastischste Modell zu sein, ist aber sehr stark darin, nutzbare und wiederholbare Ergebnisse zu liefern. Das ist wertvoll für Produktteams, Agenturen und Creator, die einen verlässlichen Workflow mehr brauchen als eine spektakuläre Demo.

Die Schwäche ist, dass die Bewegung teilweise so kontrolliert wirkt, dass sie fast zu vorsichtig erscheint. In actionreichen Szenen oder bei sehr konkreten Bewegungsanweisungen tendiert Runway eher zu glatten, sicheren Ergebnissen als zu aggressiver, dramatischer Dynamik. Das ist gut für Produktionsstabilität, aber weniger spannend, wenn du starke cineastische Überzeichnung willst.

Für die meisten Teams ist Runway trotzdem eine der besten Standardoptionen. Es ist weder das günstigste noch immer das mutigste Modell, aber eines der ausgereiftesten End-to-End-Image-to-Video-Produkte am Markt.

3. Google Veo 3.1

Google Veo 3.1 sticht heraus, weil es sich mehr wie ein Enterprise-Modell als wie ein Creator-Spielzeug anfühlt. Google stellt Veo über sein KI-Ökosystem und Vertex-nahe Tools bereit, und aktuelle Informationen weisen auf laufende Verbesserungen hin, etwa 1080p-Support, vertikale Videoformate und niedrigere Preise pro Sekunde.

Die Kernstärke ist Plattform-Ernsthaftigkeit. Veo ist attraktiv, wenn du Image-to-Video-Generierung in ein größeres Produkt oder einen Workflow integrieren möchtest, der auf Google-Infrastruktur aufsetzt. Das macht es für SaaS-Produkte, interne Tools und entwicklerorientierte Deployments interessant.

Wo Veo noch nicht perfekt ist, ist die Kontrolle über längere Sequenzen. Wie viele Top-Modelle kämpft es weiterhin mit Subjektkonsistenz und Szenenlogik, sobald Clips länger, dichter oder physikalisch komplexer werden. Mit anderen Worten: Veo liefert hochwertige Clips, löst aber nicht automatisch jedes schwere Kontinuitätsproblem nach den ersten Sekunden.

Für API-orientierte Käufer ist Veo eines der stärksten Modelle auf dieser Liste, weil es Modellqualität mit einem Ökosystem verbindet, das sich nach echter Deployment-Tauglichkeit anfühlt.

4. OpenAI Sora 2

OpenAI Sora 2 ist eine der flexibelsten Optionen, weil es Consumer-Nutzung und Entwickler-Nutzung ungewöhnlich gut verbindet. Laut den öffentlichen Materialien von OpenAI können Nutzer ein Bild hochladen, um daraus Videos zu erzeugen, und die API-Preisstruktur macht eine kommerzielle Bewertung leichter als bei vielen Wettbewerbern.

Der größte Vorteil von Sora 2 ist seine Bandbreite. Es funktioniert sowohl als Mainstream-App für Creator als auch als ernstzunehmendes API-Modell für Teams, die Videofunktionen in Produkte integrieren. Diese Flexibilität ist für Marktplätze und Plattformen besonders wertvoll.

Die Schwächen entsprechen den typischen Problemen hochwertiger generativer Videomodelle: zeitliche Inkonsistenz, unvollkommene Physik und Instabilität in geschäftigen Szenen. Visuell ist OpenAI stark, aber bei präziser Crowd-Action, dichter Bewegung oder langen logischen Sequenzen driftet das Modell noch oder vereinfacht Bewegung auf Kosten des Realismus.

Sora 2 gehört zu den besten Allround-Modellen hier. Es ist nicht in jedem Stil der absolute Spezialist, aber eines der am leichtesten zu rechtfertigenden Premium-Modelle für Creator und Produktteams.

5. Kling 3.0

Kling 3.0 sticht weiterhin durch Realismus und dramatische Bewegung hervor. Neuere Ökosystemseiten beschreiben es als Flaggschiff-Videomodell mit stärkerer Konsistenz, nativem Audio und fotorealistischerem cineastischen Output, was gut zum Ruf passt, den Kling im letzten Jahr aufgebaut hat.

Sein größter Reiz ist, wie lebendig es wirkt. Kling ist oft dann am stärksten, wenn das Ziel nicht nur lautet "Bewege dieses Bild", sondern "Mache daraus einen cineastischen Clip mit klarer Dynamik". Menschliche Motive, dramatisches Licht und kurzvideo-taugliche Bewegung profitieren besonders von diesem Stil.

Der Trade-off ist Präzision. Modelle mit starkem cineastischem Bias übertreiben mitunter die Dramatik auf Kosten exakter Kontrolle. Kling ist weniger ideal, wenn du subtile Action, zurückhaltende Bewegung oder sehr genaue Prompt-Befolgung brauchst. Es ist oft überzeugender als wörtlich.

Damit ist Kling 3.0 eine starke Wahl für Premium-Creator-Apps und visuell mutige Consumer-Produkte, insbesondere wenn Realismus und Bewegungswucht wichtiger sind als konservative Vorhersagbarkeit.

Kling 3.0 jetzt kostenlos testen

6. Luma Ray 3.14

Luma Ray 3.14 ist eines der stärksten Modelle hier, wenn es um die cineastische Interpretation von Standbildern geht. Laut den offiziellen Materialien unterstützt Ray 3.14 natives 1080p, arbeitet viermal schneller, ist dreimal günstiger als zuvor und verbessert die Bewegungskonsistenz, während Dream Machine weiterhin Generierung aus Text, Bildern oder Clips unterstützt.

Der zentrale Vorteil von Luma ist das ästhetische Gefühl. Es ist sehr gut darin, einem Standbild Bewegung zu geben, die gestaltet statt bloß animiert wirkt. Für visuelles Storytelling, Kampagnenbilder, animierte Concept Art oder hochwertigere Brand-Inhalte ist Ray 3.14 oft eine der attraktivsten Optionen am Markt.

Die Schwäche liegt in dichter Kontrolle. Luma ist hervorragend, wenn cineastische Interpretation im Vordergrund steht, aber weniger natürlich für dicht gepackte Interaktionen, präzise Multi-Charakter-Action oder streng befolgte Anweisungen über viele bewegte Elemente hinweg. Es ist eher ein Storytelling-Modell als ein chirurgisch präzises Motion-Modell.

Für Kreativteams, die Stilgefühl und starke Bewegung aus Standbildern wollen, bleibt Luma eine der besten Entscheidungen. Für Teams, die strenge Shot-Logik und kontrollierte Komplexität brauchen, sind andere Wettbewerber stärker.

7. Vidu Q3

Vidu Q3 ist eines der praktischsten Modelle auf dieser Liste. Laut offizieller Seite kann es 16-Sekunden-Videos mit synchronisiertem Dialog, Voice-over, Soundeffekten und Musik erzeugen sowie präzise Kamerasteuerung bieten. Das ist stark, weil viele Image-to-Video-Tools immer noch nur kurze, stumme Visual-Clips liefern.

Besonders interessant ist bei Vidu das Verhältnis von Wert zu Fähigkeit. Das Modell verbindet längere Generierung, natives Audio und Creator-freundliche Workflows, ohne sich ausschließlich als Luxusprodukt zu positionieren. Für Teams, die mehr Storytelling-Spielraum bei besserer Kostendisziplin wollen, ist Vidu leicht zu mögen.

Die Einschränkung liegt in der Obergrenze. Vidu kann viel, aber in den anspruchsvollsten Szenen wirken Bewegung und Feinschliff oft nicht so stark wie bei Seedance, Kling, Sora oder Luma. Für viele Produktanwendungen ist es stark genug, aber es gewinnt nicht unbedingt jeden reinen Wow-Vergleich.

Dennoch ist Vidu für API-Käufer, die eine praktikable Balance aus Preis, Dauer, Audio-Unterstützung und brauchbarem Output suchen, womöglich eine der klügsten Entscheidungen. Es ist nicht nur günstig, sondern strategisch nützlich.

Vidu Q3 jetzt kostenlos testen

8. Pika 2.5

Pika 2.5 bleibt eines der zugänglichsten Image-to-Video-Tools am Markt. Preis- und Produktseiten betonen breiten Zugang zu den Pika-2.5-Funktionen, creator-orientierte Effekte und neuere expressive Features wie Pikaformance, mit denen Bilder singen, sprechen oder sich an Audio anpassen können – bei nahezu Echtzeit-Generierung.

Die Stärke von Pika ist Tempo und Einfachheit. Es ist ein hervorragendes Modell für Creator, die statische Bilder ohne komplizierte Produktionsumgebung in lebendige Clips verwandeln möchten. Auch für Experimente, Memes, Social Content und leichtere Content-Pipelines ist es leicht zu empfehlen.

Die Schwäche liegt bei Realismus und Kontrollobergrenze. Im Vergleich zu höherwertigen cineastischen Modellen zeigt Pika eher schwächere Subjektkonsistenz, weniger feine Physik und weniger präzise Regiekontrolle. Das macht es nicht schlecht, sondern eher passend für schnelle, expressive Generierung als für Premium-Filmlook.

Pika ist am besten als sehr nützliches Creator-Modell zu verstehen und nicht als Top-Tier-Cinematic-Engine. Es ist unterhaltsam, effektiv und schnell, aber nicht die stärkste Wahl, wenn maximale Realitätsnähe oder exakte Motion-Choreografie gefragt sind.

9. Wan 2.6

Wan 2.6 ist aus API-Sicht besonders interessant, weil es als einheitliche Videomodell-Familie positioniert ist und nicht als singuläres Feature. Offizielle und Marketplace-Seiten beschreiben Unterstützung für text-to-video, image-to-video und video-to-video, mit bis zu 15 Sekunden 1080p und nativ synchronisiertem Audio.

Die größte Stärke ist die Breite. Wenn du ein Produkt baust, das mehrere Video-Generierungsmodi hinter einer Oberfläche braucht, ist Wan 2.6 leichter zu rechtfertigen als ein Tool, das vor allem für einen einzelnen Consumer-Workflow gebaut wurde. Das macht es attraktiv für Entwickler und API-Marktplätze.

Der Nachteil ist die Vorhersagbarkeit von Exzellenz. Eine Modellfamilie, die viele Modi abdeckt, kann sehr nützlich sein, fühlt sich aber nicht immer so optimiert an wie der beste Spezialist in jeder einzelnen Kategorie. Für image-to-video bleibt die Frage, ob die Ergebnisse in schwierigen Bewegungen oder cineastischen Anforderungen konstant mit den Premium-Rivalen mithalten können.

Wan 2.6 ist deshalb weniger eine Hype-Wahl als eine Systemwahl. Es ergibt am meisten Sinn, wenn dir Abdeckung, API-Struktur und Produktflexibilität über mehrere Video-Workflows hinweg wichtig sind.

Wan 2.6 jetzt kostenlos testen

10. Adobe Firefly Video

Adobe Firefly Video ist das konservativste Modell in diesem Vergleich, aber genau darin liegt sein Wert. Offizielle Image-to-Video-Seiten von Adobe betonen glatte dynamische Videos aus Original-Artwork oder Bildern, Full-HD-Ausgabe bis 1080p und Integration in das breitere Firefly- und Creative-Cloud-Ökosystem. Adobe positioniert Firefly weiterhin rund um kommerziell sicherere kreative Workflows.

Die größte Stärke ist Workflow-Vertrauen. Adobe versucht nicht, der wildeste oder experimentellste Videogenerator zu sein. Stattdessen baut es ein System, das zu den bestehenden Arbeitsweisen von Agenturen, Designteams und Enterprise-Creators passt. Das macht Firefly besonders attraktiv, wenn image-to-video Teil eines größeren Design-Workflows ist.

Die zentrale Schwäche ist geringere Bewegungsambition. Firefly-generierte Videos wirken glatter und kontrollierter, aber auch konservativer. Wenn du dramatische cineastische Bewegung, starke physikalische Ausdruckskraft oder den größten AI-Wow-Effekt willst, ist Firefly oft weniger aggressiv als dedizierte Video-Rivalen.

Für viele Business-Nutzer ist dieser Trade-off es wert. Firefly steht vielleicht nicht an der Spitze purer Kreativ-Performance-Rankings, ist aber eine der am leichtesten zu verteidigenden Image-to-Video-Optionen in kommerziellen Workflows, in denen Ökosystem-Fit ebenso wichtig ist wie Rohleistung.

Welches Image-to-Video-Modell ist für API-Käufer am besten?

Für Premium-Qualität und fortgeschrittene Kontrolle bleiben Seedance 2.0, Kling 3.0, Veo 3.1 und Runway die überzeugendsten Optionen.

Die praktische Schlussfolgerung ist einfach: Das "beste" Modell hängt davon ab, was du tatsächlich baust. Wenn cineastische Kontrolle Priorität hat, tendierst du zu Seedance oder Kling. Wenn du vorhersehbare API-Kosten brauchst, ist Vidu leichter zu rechtfertigen. Wenn du über mehrere Anbieter und Use Cases hinweg flexibel bleiben willst, ist ein Multi-Model-API-Marketplace-Ansatz meist sinnvoller als eine frühe Festlegung auf ein einzelnes geschlossenes Ökosystem.

ModelHunter.AI besuchen: All-in-One AI API Store

FAQ

Was ist 2026 das beste Image-to-Video-KI-Modell?

Es gibt keinen universellen Einzelsieger, aber Seedance 2.0, Kling 3.0, Runway Gen-4 / Gen-4.5, Veo 3.1 und Sora 2 gehören zu den stärksten Optionen – je nachdem, ob dir Kontrolle, Realismus, Workflow-Reife oder API-Zugang wichtiger ist.

Welches Image-to-Video-Modell ist am günstigsten?

Unter den Modellen mit aktuell sichtbarer öffentlicher Preisangabe in diesem Vergleich ist Vidu Q3 Turbo auf ModelHunter mit $0.06/second eine der klarsten API-Preisoptionen. Pika bietet ebenfalls einen günstigeren Consumer-Einstieg, während Premium-Modelle wie Veo oder Enterprise-Plattformen schnell teurer werden können.

Unterstützt ModelHunter Image-to-Video-APIs?

Ja. Der Live-Modellmarkt von ModelHunter listet Image-to-Video API ausdrücklich als Produktkategorie und zeigt aktuell mehrere relevante Marken und Modelle, darunter Seedance, Kling, Vidu und Wan.