Introducción

Si estás eligiendo una Image to Video API en 2026, la calidad por sí sola ya no basta. Los mejores modelos compiten en realismo del movimiento, consistencia, control de cámara, soporte de audio, velocidad de generación y facilidad de integración en un producto. Por eso esta categoría es tan relevante para desarrolladores, startups, equipos creativos y plataformas de IA: el modelo correcto puede cambiar tanto la calidad de salida como la estructura de costos.

ModelHunter es una capa API unificada para modelos de video, imagen y audio, y su mercado en vivo ya destaca marcas como Vidu, Seedance, Kling, Seedream, Gemini y Wan, con image-to-video como una categoría API de primer nivel.

En lugar de juzgar estos modelos solo por demos llamativas, esta guía se centra en lo que importa en uso real: funciones, pros y contras, flujos de trabajo adecuados, visibilidad de precios y disponibilidad actual. Para los equipos que evalúan qué modelo integrar en su producto o proceso, estos son los 10 modelos de imagen a video que vale la pena seguir en 2026.

Tabla comparativa rápida y resumen

A grandes rasgos, el mercado se divide en algunos grupos muy claros. Seedance 2.0, Runway Gen-4 y Gen-4.5, Google Veo 3.1 y OpenAI Sora 2 son las opciones más sólidas para calidad premium y control avanzado. Kling 3.0 y Luma Ray 3.14 destacan por su movimiento cinematográfico y su pulido visual. Vidu Q3, Pika 2.5 y Wan 2.6 resultan especialmente atractivos cuando importan la velocidad, el costo o la flexibilidad de producto. Adobe Firefly sigue siendo la opción más segura para equipos comerciales sensibles a la marca, porque Adobe continúa posicionándolo en torno a una generación más segura para uso comercial e integración con Creative Cloud.

| Model | Ideal para | Fortaleza principal | Trade-off principal |

|---|---|---|---|

| Seedance 2.0 | Control cinematográfico | Referencias multimodales y control de planos tipo director | La consistencia en escenas complejas sigue siendo difícil |

| Runway Gen-4 / Gen-4.5 | Flujos de producción fiables | Gran continuidad desde una sola imagen y UX madura | El movimiento puede sentirse más seguro y contenido |

| Google Veo 3.1 | Despliegue API empresarial | Calidad premium más respaldo del ecosistema Google | Las secuencias más largas o densas aún derivan |

| OpenAI Sora 2 | Uso amplio para creadores y desarrolladores | Cubre muy bien flujos de consumo y API | La consistencia temporal sigue siendo imperfecta |

| Kling 3.0 | Movimiento dramático y cinematográfico | Realismo, energía y dinamismo ideal para video social | Menor precisión de control fino |

| Luma Ray 3.14 | Storytelling visual estético | Movimiento que parece diseñado, no solo animado | Menos adecuado para acción densa y control estricto |

| Vidu Q3 | Storytelling con conciencia de costo | Clips largos, audio nativo y utilidad práctica | Menor techo de pulido que el segmento premium |

| Pika 2.5 | Iteración rápida para creadores | Velocidad, accesibilidad y efectos expresivos | Menor techo de realismo y control |

| Wan 2.6 | Productos de video multimodo | Familia unificada entre T2V, I2V y V2V | La amplitud no siempre supera al mejor especialista |

| Adobe Firefly Video | Workflows comerciales | Buen encaje en ecosistema y posicionamiento brand-safe | Ambición más conservadora en movimiento |

Análisis detallado de cada modelo

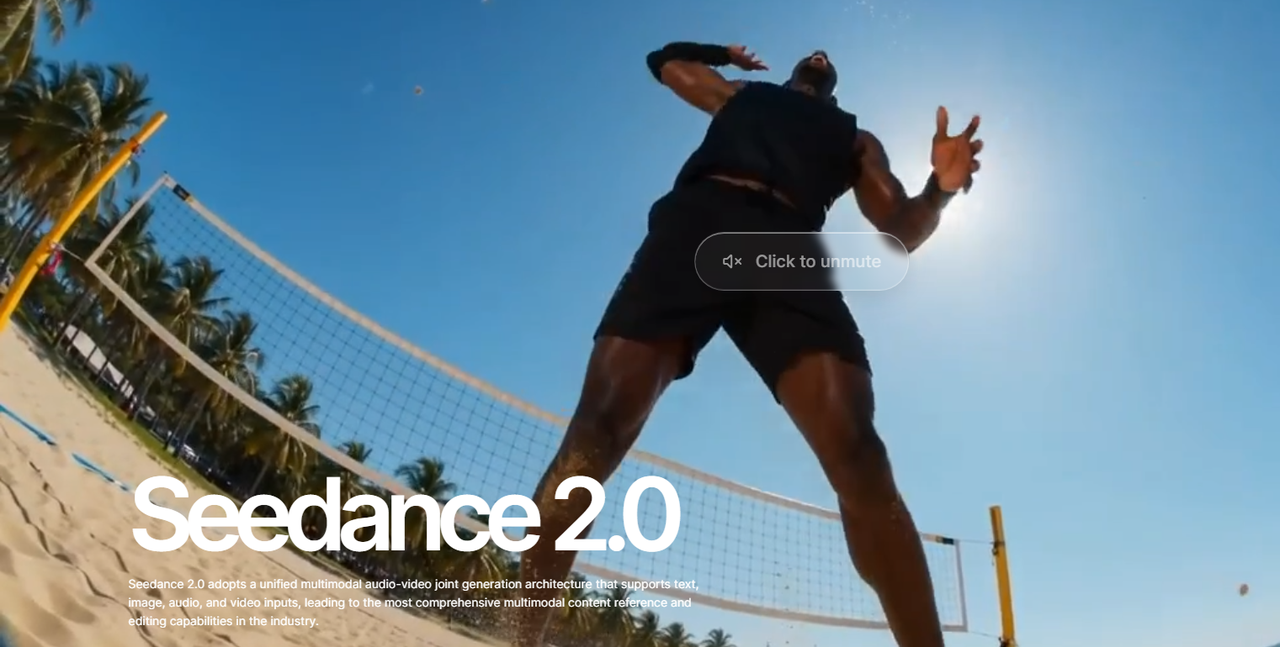

1. Seedance 2.0

Seedance 2.0 parece el modelo más orientado al control dentro de este grupo. ByteDance lo posiciona alrededor de entradas de referencia multimodales, incluidas imágenes, audio y video, con control de nivel director sobre actuación, iluminación, sombras y movimiento de cámara. Eso importa porque muchas herramientas image-to-video todavía se comportan como motores de animación glorificados, mientras que Seedance apunta claramente al diseño de planos y a la generación cinematográfica guiada.

Su mayor fortaleza es lo seriamente que trata las referencias. Si tu flujo parte de una imagen fija pero también te importan el tono, el lenguaje del movimiento, el sonido y la composición del plano, Seedance es uno de los pocos modelos que lo aborda como una tarea creativa unificada y no como una conversión de un clic. Eso lo hace especialmente atractivo para creatividad publicitaria, storytelling de marca y video corto de mayor nivel.

Su principal debilidad no está en la idea, sino en la ejecución bajo presión. Los problemas avanzados de video siguen presentes: estabilidad del detalle, consistencia entre varias personas y precisión de lip-sync en escenas complejas siguen siendo difíciles. En la práctica, Seedance es más fuerte cuando buscas dirección cinematográfica y movimiento estructurado, pero todavía no garantiza secuencias largas o saturadas sin fallos.

Para compradores de API, conviene entender Seedance 2.0 como un motor creativo premium y no como un modelo commodity de baja fricción. Es el tipo de modelo que se usa cuando la calidad del control importa más que la previsibilidad de costos.

Prueba ahora la API de Seedance 2.0

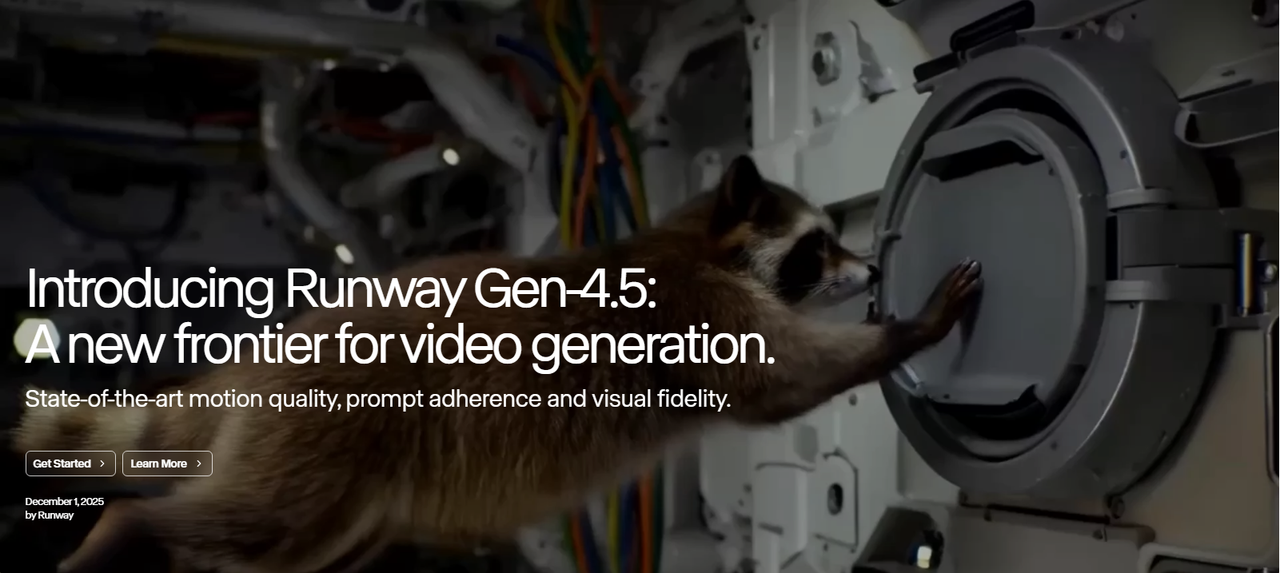

2. Runway Gen-4 / Gen-4.5

Runway sigue siendo una de las recomendaciones más seguras porque no es solo una familia de modelos potente, sino también un entorno de producto maduro. La propuesta de Gen-4 enfatiza personajes, objetos y ubicaciones consistentes a partir de una sola imagen de referencia, lo cual es una ventaja real para usuarios image-to-video que necesitan continuidad y no solo aciertos aislados.

En uso real, la mayor ventaja de Runway es el equilibrio. No siempre intenta ser el más experimental ni el más cinematográfico, pero es muy fuerte produciendo resultados utilizables y repetibles. Eso es valioso para equipos de producto, agencias y creadores que necesitan un flujo fiable más que una demo espectacular.

Su debilidad es que su estilo de movimiento a veces puede sentirse demasiado controlado y, por lo tanto, algo contenido. En escenas de mucha acción o con prompts de movimiento muy específicos, Runway tiende a inclinarse por un resultado más suave y seguro, en lugar de uno más agresivo y dramático. Eso es útil para la estabilidad de producción, pero menos emocionante si quieres exageración cinematográfica fuerte.

Para la mayoría de los equipos, Runway sigue siendo una de las mejores opciones por defecto. No es el más barato ni siempre el más audaz, pero sí una de las plataformas image-to-video más pulidas de extremo a extremo.

3. Google Veo 3.1

Google Veo 3.1 destaca porque se siente más como un modelo de grado empresarial que como un juguete para creadores. Google lo expone a través de su ecosistema de suscripción IA y herramientas relacionadas con Vertex, y la cobertura reciente resalta mejoras continuas como soporte 1080p, soporte vertical y precios por segundo más bajos que antes.

Su fortaleza central es la seriedad de plataforma. Veo resulta atractivo cuando quieres que la generación image-to-video viva dentro de un producto o flujo mayor respaldado por infraestructura de Google. Eso lo hace interesante para productos SaaS, herramientas internas y despliegues orientados a desarrolladores.

Donde Veo todavía muestra límites es en el control de secuencias largas. Como muchos modelos de primer nivel, aún puede sufrir con la coherencia del sujeto y la lógica de escena cuando los planos se vuelven más largos, complejos o densos. En otras palabras, Veo es fuerte para clips de aspecto premium, pero eso no significa que resuelva automáticamente todos los problemas de continuidad difíciles.

Para compradores centrados en API, Veo es una de las opciones más fuertes de esta lista porque combina calidad de modelo con un ecosistema que se siente preparado para despliegue real.

4. OpenAI Sora 2

OpenAI Sora 2 es una de las opciones más flexibles porque conecta de forma poco común el uso de consumo y el uso para desarrolladores. Los materiales públicos de OpenAI muestran que los usuarios pueden subir una imagen para crear videos, y el precio de la API facilita su evaluación comercial frente a muchos competidores.

La mayor ventaja de Sora 2 es su alcance. Puede funcionar como experiencia mainstream para creadores y también como modelo respaldado por API para equipos que incorporan video a productos. Esa flexibilidad importa mucho para plataformas y marketplaces.

Sus debilidades son las habituales de los modelos generativos de alto nivel: inconsistencia temporal, física imperfecta e inestabilidad en escenas cargadas. Las herramientas de OpenAI son visualmente fuertes, pero cuando se exige acción precisa de multitudes, movimiento denso o secuencias largas con lógica, el modelo todavía deriva o simplifica el movimiento de forma que rompe el realismo.

Sora 2 es una de las mejores opciones todoterreno de esta lista. Tal vez no sea siempre el mejor especialista para un estilo concreto, pero sí uno de los modelos premium más fáciles de justificar para creadores y equipos de producto.

5. Kling 3.0

Kling 3.0 sigue destacando por su realismo y su movimiento dramático. Páginas recientes del ecosistema lo describen como un modelo de video flagship con mayor consistencia, audio nativo y una salida más fotorealista y cinematográfica.

Su mayor atractivo es la energía que transmite. Kling es más fuerte cuando el objetivo no es solo “mover esta imagen”, sino “convertir esta imagen en un clip cinematográfico con impulso visible”. Los sujetos humanos, la iluminación dramática y el movimiento apto para formatos sociales se benefician mucho de ese estilo.

El trade-off es la precisión. Los modelos con fuerte sesgo cinematográfico a veces sobrerrepresentan el drama a costa del control exacto. Kling puede ser menos ideal cuando se necesita acción sutil, movimiento contenido o obediencia muy fina al prompt. A menudo es más convincente que literal.

Eso convierte a Kling 3.0 en una gran opción para apps premium de creadores y productos de consumo visualmente intensos, especialmente cuando el realismo y la pegada del movimiento importan más que la previsibilidad conservadora.

6. Luma Ray 3.14

Luma Ray 3.14 es uno de los modelos más fuertes aquí para dar una interpretación cinematográfica a imágenes fijas. Los materiales oficiales de Luma dicen que Ray 3.14 añade generación nativa en 1080p, funciona cuatro veces más rápido, cuesta tres veces menos y mejora la consistencia del movimiento, mientras Dream Machine sigue admitiendo generación desde texto, imágenes o clips.

La ventaja clave de Luma es su sentido estético. Es muy bueno tomando una imagen fija y dándole un movimiento que parece diseñado y no simplemente animado. Si tu caso de uso es storytelling visual, piezas de campaña, concept art en movimiento o contenido de marca pulido, Ray 3.14 suele ser una de las opciones más atractivas del mercado.

Su punto débil es el control denso. Luma sobresale cuando la tarea image-to-video se beneficia de una interpretación cinematográfica, pero es menos natural en interacciones cargadas, acción multi-personaje precisa o seguimiento rígido de instrucciones sobre muchos elementos en movimiento. Es más un modelo de storytelling que un modelo quirúrgico de movimiento.

Para equipos creativos que quieren buen gusto y movimiento pulido a partir de imágenes fijas, Luma sigue siendo una de las mejores elecciones. Para equipos que necesitan lógica de plano estricta y complejidad controlada, otros rivales son más fuertes.

7. Vidu Q3

Vidu Q3 es uno de los modelos más prácticos de esta lista. Su página oficial dice que puede generar videos de 16 segundos con diálogo sincronizado, voz en off, efectos de sonido y música, además de control de cámara preciso. Eso es una propuesta sólida, porque muchas herramientas image-to-video todavía se quedan en clips visuales cortos y mudos.

Lo que vuelve especialmente interesante a Vidu es su relación valor-capacidad. El modelo combina generación más larga, audio nativo y workflows amigables para creadores sin posicionarse como un producto puramente de lujo. Para equipos que quieren más rango narrativo con mejor disciplina de costos, Vidu resulta fácil de justificar.

Su limitación está en el techo. Vidu puede hacer mucho, pero en las escenas más exigentes su realismo de movimiento y su pulido pueden sentirse menos refinados que los de Seedance, Kling, Sora o Luma. Es lo bastante fuerte para muchos casos de uso de producto, pero menos probable que gane comparativas puramente basadas en el efecto wow.

Aun así, Vidu puede ser una de las decisiones más inteligentes para compradores de API que quieren equilibrio práctico entre precio, duración, audio nativo y salida utilizable. No es solo asequible; es estratégicamente útil.

8. Pika 2.5

Pika 2.5 sigue siendo una de las herramientas image-to-video más accesibles del mercado. Sus páginas de producto y precios enfatizan el acceso amplio a funciones, efectos orientados a creadores y funciones expresivas más recientes como Pikaformance, que permiten que las imágenes canten, hablen o se sincronicen con sonido con una generación casi en tiempo real.

La fortaleza de Pika es la velocidad y la facilidad. Es un excelente modelo para creadores que quieren convertir imágenes fijas en clips vivos sin entrar en un entorno de producción complicado. También es fácil de recomendar para experimentación, memes, contenido social y pipelines de contenido más ligeros.

Su debilidad está en el techo de realismo y control. Frente a modelos cinematográficos más premium, Pika es más propenso a mostrar menor consistencia de sujeto, física menos refinada y menor precisión directorial. Eso no lo hace malo; simplemente lo orienta mejor a generación rápida y expresiva que a salida premium estilo cine.

Pika se entiende mejor como un modelo de creador muy útil, no como un motor cinematográfico de primer nivel. Es divertido, eficaz y rápido, pero no la opción más fuerte cuando el objetivo es máximo realismo o coreografía de movimiento precisa.

9. Wan 2.6

Wan 2.6 es una de las entradas más interesantes desde el punto de vista API porque está posicionado como una familia unificada de modelos de video y no como una sola función estrecha. Las páginas oficiales y de marketplace lo describen como compatible con text-to-video, image-to-video y video-to-video, con hasta 15 segundos en 1080p y audio sincronizado nativo.

Su mayor ventaja es la amplitud. Si estás construyendo un producto que necesita múltiples modos de generación de video detrás de una sola interfaz, Wan 2.6 es más fácil de justificar que una herramienta construida principalmente para un único flujo de consumo. Eso lo vuelve atractivo para desarrolladores y marketplaces de API.

El inconveniente está en la previsibilidad de la excelencia. Una familia que intenta cubrir muchos modos puede ser muy útil, pero no siempre se siente tan optimizada como el mejor especialista en cada categoría. Para image-to-video, la verdadera pregunta es si puede igualar de manera consistente el pulido de los rivales premium en movimiento difícil o exigencias cinematográficas.

Por eso Wan 2.6 es menos una elección por hype y más una elección de sistema. Tiene más sentido cuando te importan la cobertura, la estructura de API y la flexibilidad del producto a través de varios workflows de video.

10. Adobe Firefly Video

Adobe Firefly Video es el modelo más conservador de esta comparativa, pero precisamente ahí reside su valor. Las páginas oficiales de Adobe sobre image-to-video destacan video dinámico fluido a partir de artwork o imágenes originales, salida Full HD hasta 1080p e integración con el ecosistema Firefly y Creative Cloud. Adobe también sigue enmarcando Firefly alrededor de workflows creativos más seguros para uso comercial.

Su mayor fortaleza es la confianza de workflow. Adobe no intenta ser el generador de video más salvaje ni más experimental. En cambio, construye un sistema que encaja con la forma en que ya trabajan agencias, equipos de diseño y creadores empresariales. Eso hace a Firefly especialmente atractivo cuando image-to-video forma parte de un pipeline de diseño más amplio.

Su debilidad central es la ambición de movimiento. Los videos generados por Firefly suelen sentirse más suaves y controlados, pero también más conservadores. Si quieres movimiento cinematográfico dramático, física muy expresiva o el mayor “wow” de IA, Firefly suele ser menos agresivo que rivales centrados en video.

Para muchos usuarios de negocio, ese trade-off merece la pena. Puede que Firefly no encabece rankings de rendimiento creativo puro, pero sí es una de las opciones image-to-video más fáciles de defender dentro de workflows comerciales donde el encaje con el ecosistema importa tanto como el estilo bruto del modelo.

¿Qué modelo de imagen a video es mejor para compradores de API?

Para calidad premium y control avanzado, Seedance 2.0, Kling 3.0, Veo 3.1 y Runway siguen siendo las opciones más convincentes.

La conclusión práctica es simple: el “mejor” modelo depende de lo que realmente estés construyendo. Si tu prioridad es el control cinematográfico, te inclinarás por Seedance o Kling. Si necesitas una economía API más predecible, Vidu es más fácil de justificar. Si quieres mantener amplitud de opciones entre proveedores y casos de uso, un enfoque de marketplace API multi-modelo suele tener más sentido que apostar desde el principio por un solo ecosistema cerrado.

Visita ModelHunter.AI: tienda integral de APIs de IA

FAQ

¿Cuál es el mejor modelo de IA de imagen a video en 2026?

No existe un ganador universal único, pero Seedance 2.0, Kling 3.0, Runway Gen-4 / Gen-4.5, Veo 3.1 y Sora 2 están entre las opciones más fuertes, según priorices control, realismo, madurez del workflow o acceso API.

¿Qué modelo de imagen a video es el más asequible?

Entre los modelos con precio público visible en esta comparación, Vidu Q3 Turbo en ModelHunter a $0.06/second es una de las opciones API más claras. Pika también ofrece una entrada de consumo más barata, mientras que modelos premium como Veo o plataformas orientadas a empresa pueden encarecerse rápidamente.

¿ModelHunter soporta APIs de image-to-video?

Sí. El mercado en vivo de ModelHunter enumera explícitamente Image to Video API como categoría de producto y actualmente incluye varias marcas y modelos relevantes, entre ellos Seedance, Kling, Vidu y Wan.