Introdução

Se você está escolhendo uma Image to Video API em 2026, qualidade sozinha já não é suficiente. Os melhores modelos agora competem em realismo de movimento, consistência, controle de câmera, suporte a áudio, velocidade de geração e facilidade de integração em um produto. É exatamente por isso que essa categoria importa tanto para desenvolvedores, startups, equipes criativas e plataformas de IA: o modelo certo pode mudar tanto a qualidade da saída quanto a estrutura de custos.

ModelHunter é uma camada unificada de API para modelos de vídeo, imagem e áudio, e seu mercado ao vivo já destaca marcas como Vidu, Seedance, Kling, Seedream, Gemini e Wan, com image-to-video tratado como uma categoria de API de primeira classe.

Em vez de avaliar modelos apenas por demos chamativas, este guia se concentra no que importa no uso real: recursos, prós e contras, workflows mais adequados, visibilidade de preços e disponibilidade atual. Para equipes avaliando qual modelo levar para o produto ou fluxo de trabalho, estes são os 10 modelos de image-to-video que vale a pena acompanhar em 2026.

Comparação rápida e resumo

Em alto nível, o mercado se divide em alguns grupos bem claros. Seedance 2.0, Runway Gen-4 e Gen-4.5, Google Veo 3.1 e OpenAI Sora 2 são as escolhas mais fortes para qualidade premium e controle avançado. Kling 3.0 e Luma Ray 3.14 se destacam por movimento cinematográfico e acabamento visual. Vidu Q3, Pika 2.5 e Wan 2.6 ficam especialmente atraentes quando velocidade, custo ou flexibilidade de produto são prioridade. Adobe Firefly continua sendo a opção mais segura para equipes comerciais sensíveis à marca, porque a Adobe segue posicionando o Firefly em torno de geração comercialmente mais segura e integração com Creative Cloud.

| Model | Melhor para | Principal força | Principal trade-off |

|---|---|---|---|

| Seedance 2.0 | Controle cinematográfico | Referências multimodais e controle de cena em nível de direção | Consistência em cenas complexas ainda é difícil |

| Runway Gen-4 / Gen-4.5 | Workflows de produção confiáveis | Forte continuidade a partir de uma única imagem e UX madura | O movimento pode parecer mais contido |

| Google Veo 3.1 | Deploy corporativo via API | Qualidade premium e suporte do ecossistema Google | Sequências mais longas ou densas ainda derivam |

| OpenAI Sora 2 | Uso amplo para criadores e desenvolvedores | Cobre bem fluxos de consumo e API | Consistência temporal ainda é imperfeita |

| Kling 3.0 | Movimento dramático e cinematográfico | Realismo, energia e dinamismo voltado a vídeos sociais | Menor precisão no controle fino |

| Luma Ray 3.14 | Storytelling visual estético | Movimento que parece desenhado, não apenas animado | Menos adequado para ação densa e muito controlada |

| Vidu Q3 | Storytelling com foco em custo | Clipes mais longos, áudio nativo e utilidade prática | Teto de qualidade abaixo do topo premium |

| Pika 2.5 | Iteração rápida para criadores | Velocidade, acessibilidade e efeitos expressivos | Menor teto de realismo e controle |

| Wan 2.6 | Produtos de vídeo multimodo | Família unificada entre T2V, I2V e V2V | Amplitude nem sempre supera o melhor especialista |

| Adobe Firefly Video | Workflows comerciais | Forte encaixe com ecossistema e posicionamento brand-safe | Ambição mais conservadora em movimento |

Análise detalhada de cada modelo

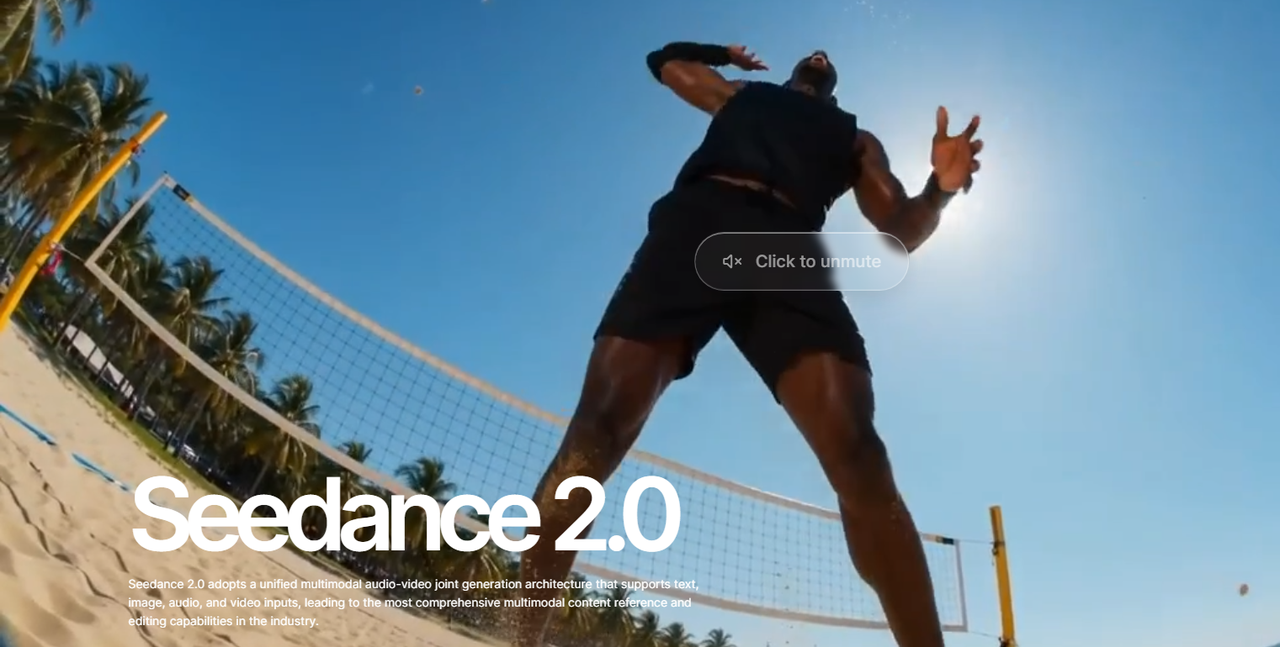

1. Seedance 2.0

Seedance 2.0 parece ser o modelo mais focado em controle dentro deste grupo. A ByteDance o posiciona em torno de entradas de referência multimodais, incluindo imagens, áudio e vídeo, com controle em nível de direção sobre performance, iluminação, sombras e movimento de câmera. Isso importa porque muitas ferramentas de image-to-video ainda se comportam como motores de animação glorificados, enquanto o Seedance mira claramente design de cenas e geração cinematográfica guiada.

Sua maior força é a forma séria como trata referências. Se seu workflow começa com uma imagem estática, mas você também se importa com clima, linguagem de movimento, som e composição de cena, o Seedance é um dos poucos modelos que lida com isso como uma tarefa criativa unificada e não como uma conversão de um clique. Isso o torna especialmente interessante para criatividade publicitária, storytelling de marca e vídeos curtos de nível mais alto.

Sua principal fraqueza não está no conceito, mas na execução sob pressão. Problemas avançados de vídeo continuam existindo: estabilidade de detalhes, consistência entre múltiplas pessoas e precisão de lip-sync em cenas complexas ainda são difíceis. Na prática, isso significa que o Seedance é mais forte quando você quer direção cinematográfica e movimento estruturado, mas ainda não garante sequências longas ou lotadas sem falhas.

Para compradores de API, faz mais sentido entender o Seedance 2.0 como um motor criativo premium e não como um modelo commodity de baixa fricção. É o tipo de modelo para usar quando qualidade de controle importa mais do que previsibilidade total de custo.

Entre agora na lista de espera da API Seedance 2.0

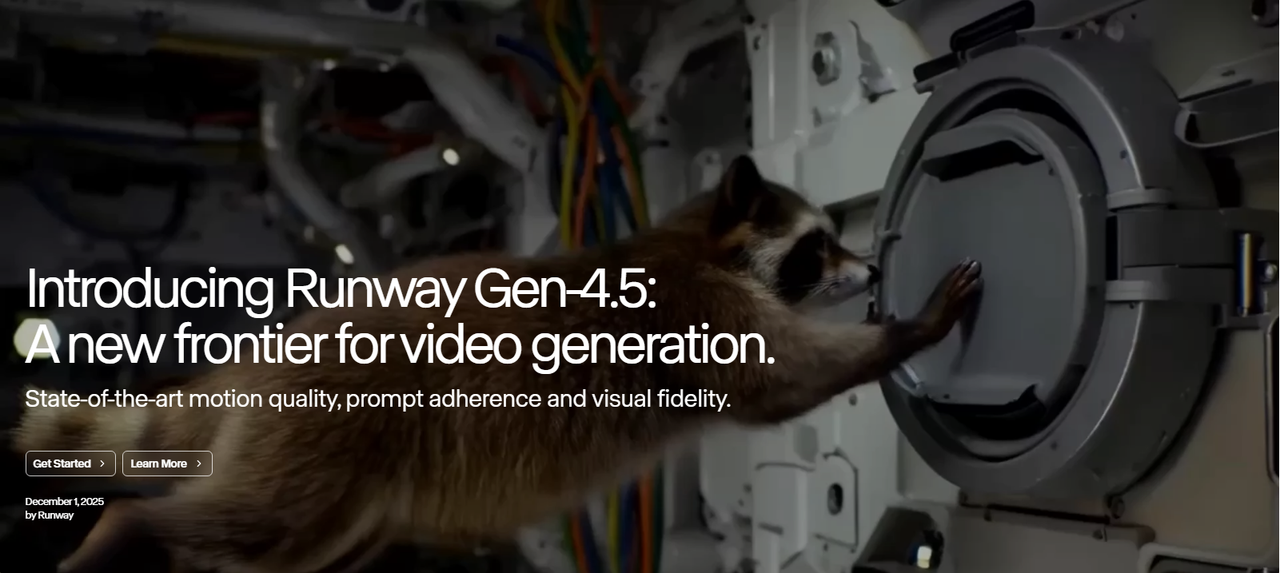

2. Runway Gen-4 / Gen-4.5

O Runway continua sendo uma das recomendações mais seguras porque não é apenas uma família forte de modelos, mas também um ambiente de produto maduro. O posicionamento do Gen-4 destaca personagens, objetos e locações consistentes a partir de uma única imagem de referência, o que é uma vantagem real para usuários de image-to-video que precisam de continuidade.

No uso real, a maior vantagem do Runway é o equilíbrio. Ele nem sempre tenta ser o mais experimental nem o mais cinematográfico, mas é muito forte em produzir resultados utilizáveis e repetíveis. Isso é valioso para equipes de produto, agências e criadores que precisam mais de um workflow confiável do que de uma demo espetacular.

Sua fraqueza é que o estilo de movimento às vezes pode parecer controlado demais e, portanto, contido demais. Em cenas de ação ou prompts muito específicos de movimento, o Runway tende a ir para um resultado mais suave e seguro em vez de mais agressivo e dramático. Isso ajuda na estabilidade de produção, mas empolga menos quando você quer exagero cinematográfico forte.

Para a maioria das equipes, o Runway ainda é uma das melhores opções padrão. Não é o mais barato nem sempre o mais ousado, mas é uma das plataformas image-to-video mais maduras de ponta a ponta.

3. Google Veo 3.1

O Google Veo 3.1 se destaca porque parece mais um modelo de nível empresarial do que um brinquedo para criadores. O Google o disponibiliza por meio de seu ecossistema de IA e ferramentas relacionadas ao Vertex, e materiais recentes apontam melhorias contínuas, como suporte a 1080p, vídeo vertical e custo por segundo mais baixo.

Sua força central é a seriedade de plataforma. O Veo é atraente quando você quer colocar geração image-to-video dentro de um produto ou workflow maior apoiado na infraestrutura do Google. Isso o torna interessante para produtos SaaS, ferramentas internas e deploys voltados a desenvolvedores.

Onde o Veo ainda mostra limites é no controle de sequências longas. Como muitos modelos de topo, ele ainda pode sofrer com consistência de sujeito e lógica de cena quando os planos ficam mais longos, densos ou fisicamente complexos. Em outras palavras, o Veo é forte para criar clipes com aparência premium, mas isso não significa que resolva automaticamente todos os problemas difíceis de continuidade.

Para compradores com foco em API, o Veo é uma das opções mais fortes desta lista porque combina qualidade de modelo com um ecossistema que parece pronto para deploy real.

4. OpenAI Sora 2

O OpenAI Sora 2 é uma das opções mais flexíveis porque conecta muito bem uso de consumo e uso para desenvolvedores. Os materiais públicos da OpenAI mostram que usuários podem enviar uma imagem para criar vídeos, e o preço da API facilita sua avaliação comercial.

A maior vantagem do Sora 2 é sua amplitude. Ele pode funcionar como experiência mainstream para criadores e também como modelo sério via API para equipes que estão colocando recursos de vídeo em produtos. Essa flexibilidade importa bastante para plataformas e marketplaces.

Suas fraquezas são as clássicas dos modelos generativos de alto nível: inconsistência temporal, física imperfeita e instabilidade em cenas carregadas. As ferramentas da OpenAI são visualmente fortes, mas quando se exige ação precisa de multidão, movimento denso ou sequências longas com lógica, o modelo ainda deriva ou simplifica o movimento de formas que quebram o realismo.

O Sora 2 continua sendo uma das melhores escolhas generalistas desta lista. Talvez não seja sempre o melhor especialista para um estilo específico, mas é um dos modelos premium mais fáceis de justificar tanto para criadores quanto para times de produto.

5. Kling 3.0

Kling 3.0 continua se destacando por realismo e movimento dramático. Páginas recentes do ecossistema o descrevem como um modelo de vídeo flagship com maior consistência, áudio nativo e saída mais fotorealista e cinematográfica.

Seu maior atrativo é o quanto ele parece vivo. O Kling costuma estar no seu melhor quando o objetivo não é apenas “mover esta imagem”, mas “transformar esta imagem em um clipe cinematográfico com impulso visível”. Sujeitos humanos, iluminação dramática e movimento voltado para formatos sociais se beneficiam muito desse estilo.

O trade-off é a precisão. Modelos com forte viés cinematográfico às vezes exageram o drama às custas do controle exato. O Kling é menos ideal quando você precisa de ação sutil, movimento contido ou aderência muito fina ao prompt. Muitas vezes ele é mais convincente do que literal.

Isso faz do Kling 3.0 uma escolha forte para apps premium de criadores e produtos de consumo com grande intensidade visual, especialmente quando realismo e impacto do movimento importam mais do que previsibilidade conservadora.

Teste grátis o Kling 3.0 agora

6. Luma Ray 3.14

O Luma Ray 3.14 é um dos modelos mais fortes aqui para dar interpretação cinematográfica a imagens estáticas. Os materiais oficiais da Luma dizem que o Ray 3.14 adiciona geração nativa em 1080p, roda quatro vezes mais rápido, custa três vezes menos e melhora a consistência do movimento, enquanto o Dream Machine continua suportando geração a partir de texto, imagens ou clipes.

A principal vantagem do Luma é o senso estético. Ele é muito bom em pegar uma imagem fixa e dar a ela um movimento que parece desenhado e não apenas animado. Se o seu caso de uso é storytelling visual, material de campanha, concept art animada ou conteúdo de marca mais refinado, o Ray 3.14 costuma ser uma das opções mais atraentes do mercado.

Seu ponto fraco é o controle denso. O Luma é excelente quando a tarefa image-to-video se beneficia de interpretação cinematográfica, mas é menos naturalmente adequado para interações cheias, ação precisa com múltiplos personagens ou seguimento rígido de instruções sobre muitos elementos em movimento. É mais um modelo de storytelling do que um modelo cirúrgico de movimento.

Para equipes criativas que querem bom gosto e movimento polido a partir de imagens estáticas, o Luma continua sendo uma das melhores escolhas. Para equipes que precisam de lógica rígida de plano e complexidade controlada, outros rivais podem ser mais fortes.

7. Vidu Q3

Vidu Q3 é um dos modelos mais práticos desta lista. Sua página oficial afirma que ele pode gerar vídeos de 16 segundos com diálogo sincronizado, voice-over, efeitos sonoros e música, além de controle preciso de câmera. Isso é forte, porque muitas ferramentas de image-to-video ainda param em clipes visuais curtos e mudos.

O que torna o Vidu especialmente interessante é a relação entre valor e capacidade. O modelo combina geração mais longa, áudio nativo e workflows amigáveis para criadores sem se posicionar como um produto puramente de luxo. Para equipes que querem maior alcance narrativo com melhor disciplina de custo, o Vidu é muito atraente.

Sua limitação está no teto. O Vidu consegue fazer bastante coisa, mas nas cenas mais exigentes seu realismo de movimento e polimento podem parecer menos refinados do que os de Seedance, Kling, Sora ou Luma. Ele é forte o suficiente para muitos casos de uso de produto, mas menos provável de vencer comparações puramente baseadas em efeito wow.

Ainda assim, o Vidu pode ser uma das escolhas mais inteligentes para compradores de API que querem equilíbrio entre preço, duração, suporte a áudio e saída utilizável. Não é apenas acessível; é estrategicamente útil.

8. Pika 2.5

O Pika 2.5 continua sendo uma das ferramentas image-to-video mais acessíveis do mercado. Suas páginas de produto e preço destacam amplo acesso aos recursos do Pika 2.5, efeitos voltados a criadores e novidades mais expressivas como Pikaformance, que podem fazer imagens cantar, falar ou sincronizar com som quase em tempo real.

A força do Pika é velocidade e facilidade. É um excelente modelo para criadores que querem transformar imagens estáticas em clipes vivos sem entrar em um ambiente de produção complicado. Também é fácil recomendá-lo para experimentação, memes, conteúdo social e pipelines mais leves.

Sua fraqueza está no teto de realismo e controle. Comparado a modelos cinematográficos mais premium, o Pika tende a mostrar menor consistência de sujeito, física menos refinada e menos precisão direcional. Isso não o torna ruim; apenas o posiciona melhor para geração rápida e expressiva do que para saída premium em estilo filme.

O Pika faz mais sentido quando entendido como um modelo de criador muito útil, e não como um mecanismo cinematográfico de primeira linha. É divertido, eficaz e rápido, mas não é a escolha mais forte quando o objetivo é máximo realismo ou coreografia de movimento muito precisa.

9. Wan 2.6

Wan 2.6 é uma das entradas mais interessantes do ponto de vista de API porque é posicionado como uma família unificada de vídeo e não como um recurso isolado. Páginas oficiais e de marketplace o descrevem como compatível com text-to-video, image-to-video e video-to-video, com até 15 segundos em 1080p e áudio sincronizado nativo.

Sua maior vantagem é a amplitude. Se você está construindo um produto que precisa de vários modos de geração de vídeo por trás de uma única interface, o Wan 2.6 é mais fácil de justificar do que uma ferramenta construída principalmente para um único workflow de consumo. Isso o torna atraente para desenvolvedores e marketplaces de API.

Sua desvantagem é a previsibilidade da excelência. Uma família que tenta cobrir muitos modos pode ser muito útil, mas nem sempre parece tão otimizada quanto o melhor especialista em cada categoria. Para image-to-video, a questão real é se consegue acompanhar de forma consistente o nível de polimento dos melhores rivais premium em movimento difícil ou exigências cinematográficas.

Por isso, o Wan 2.6 é menos uma escolha por hype e mais uma escolha de sistema. Faz mais sentido quando importam cobertura, estrutura de API e flexibilidade de produto ao longo de vários workflows de vídeo.

10. Adobe Firefly Video

O Adobe Firefly Video é o modelo mais conservador desta comparação, mas exatamente aí está seu valor. As páginas oficiais de image-to-video da Adobe enfatizam vídeo dinâmico suave a partir de artwork original ou imagens, saída Full HD de até 1080p e integração com o ecossistema Firefly e Creative Cloud. A Adobe também continua posicionando o Firefly em torno de workflows criativos mais seguros comercialmente.

Sua maior força é a confiança de workflow. A Adobe não está tentando ser o gerador de vídeo mais selvagem ou experimental. Em vez disso, está construindo um sistema que se encaixa na forma como agências, equipes de design e criadores enterprise já trabalham. Isso torna o Firefly especialmente atraente quando image-to-video faz parte de um pipeline de design mais amplo.

Sua fraqueza central é a ambição de movimento mais limitada. Os vídeos gerados pelo Firefly tendem a parecer mais suaves e controlados, mas também mais conservadores. Se você quer movimento cinematográfico dramático, física muito expressiva ou o maior efeito wow de IA, o Firefly costuma ser menos agressivo do que rivais focados em vídeo.

Para muitos usuários de negócios, esse trade-off vale a pena. O Firefly talvez não lidere rankings de performance criativa pura, mas é uma das opções image-to-video mais fáceis de defender em workflows comerciais nos quais o encaixe com o ecossistema importa tanto quanto o estilo bruto do modelo.

Qual modelo de imagem para vídeo é melhor para compradores de API?

Para qualidade premium e controle avançado, Seedance 2.0, Kling 3.0, Veo 3.1 e Runway continuam sendo as opções mais convincentes.

A conclusão prática é simples: o “melhor” modelo depende do que você está realmente construindo. Se a prioridade é controle cinematográfico, você tende para Seedance ou Kling. Se precisa de economia de API mais previsível, o Vidu é mais fácil de justificar. Se quer manter grande flexibilidade entre fornecedores e casos de uso, uma abordagem de marketplace API multi-modelo costuma fazer mais sentido do que apostar desde o início em um único ecossistema fechado.

Visite o ModelHunter.AI: loja all-in-one de APIs de IA

FAQ

Qual é o melhor modelo de IA de imagem para vídeo em 2026?

Não existe um único vencedor universal, mas Seedance 2.0, Kling 3.0, Runway Gen-4 / Gen-4.5, Veo 3.1 e Sora 2 estão entre as opções mais fortes, dependendo de você priorizar controle, realismo, maturidade de workflow ou acesso via API.

Qual modelo de imagem para vídeo é o mais acessível?

Entre os modelos com preço público visível nesta comparação, o Vidu Q3 Turbo no ModelHunter a $0.06/second é uma das opções de preço de API mais claras. O Pika também oferece uma entrada mais barata para consumidores, enquanto modelos premium como Veo ou plataformas voltadas para enterprise podem ficar caras rapidamente.

O ModelHunter oferece suporte a APIs de image-to-video?

Sim. O mercado ao vivo do ModelHunter lista explicitamente Image to Video API como categoria de produto e atualmente inclui várias marcas e modelos relevantes, entre eles Seedance, Kling, Vidu e Wan.